Qwen3.6对比Gemma4:本地MoE模型选型终极指南

type

status

date

slug

summary

tags

category

icon

password

网址

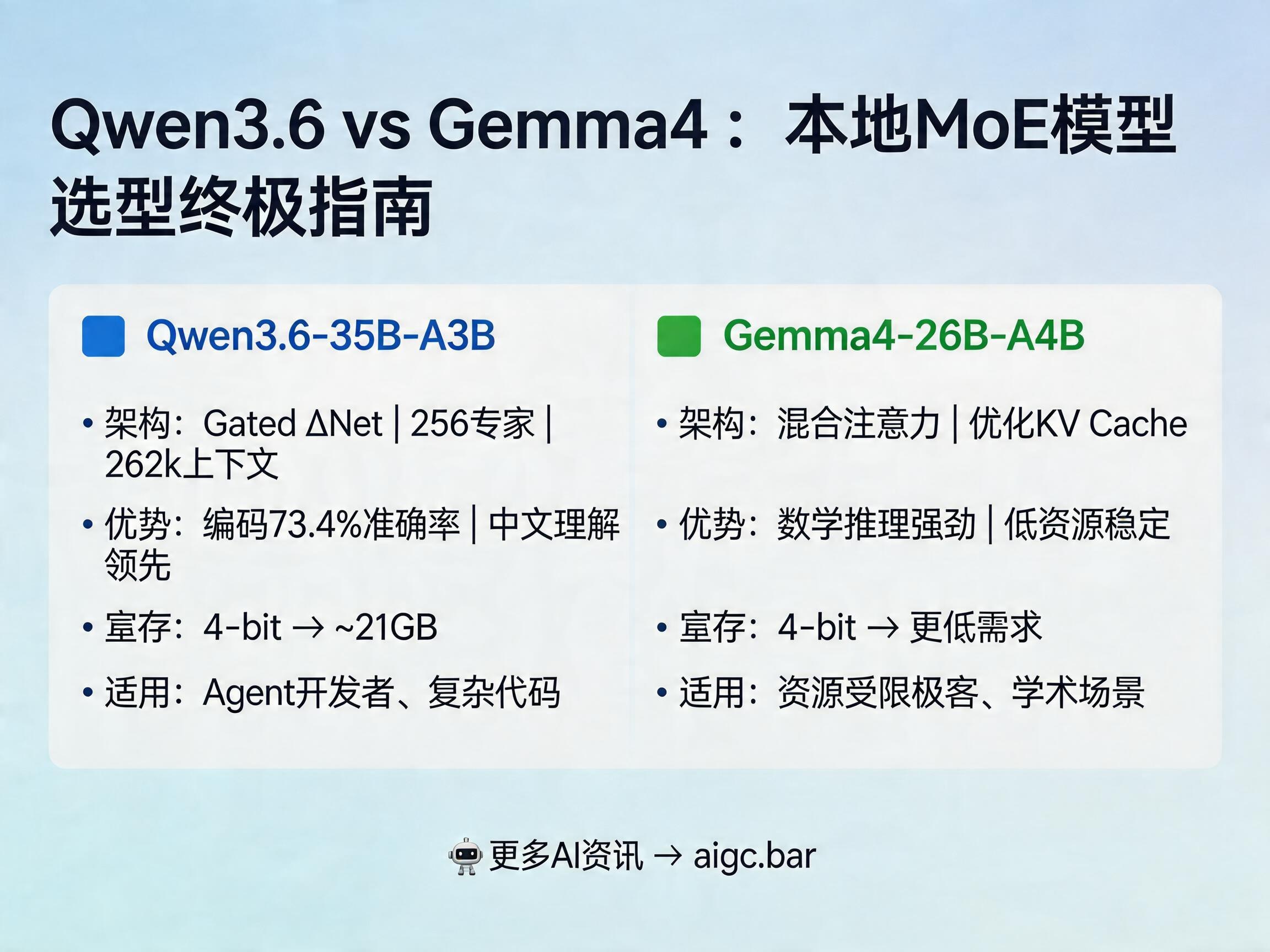

随着本地大模型技术的飞速发展,混合专家模型(MoE)已成为极客和开发者绕不开的话题。近期,阿里开源的Qwen3.6-35B-A3B与谷歌的Gemma4-26B-A4B同台竞技,引发了关于“下一代本地模型”的激烈讨论。对于想要在本地运行高效Agent的开发者而言,如何在两者之间做选择?本文将结合最新的AI资讯,为您深度拆解这一技术选型难题。

架构逻辑:极致性能与均衡稳健的对垒

虽然同属MoE架构,但Qwen3.6与Gemma4的设计哲学截然不同。

Qwen3.6-35B-A3B采用了先进的Gated ΔNet设计,虽然总参数量达到35B,但推理时仅激活3B参数。其核心优势在于拥有256个专家组成的网络,配合高达262,144的超长上下文,使其在复杂逻辑推理和历史信息保留上表现出色。

相比之下,Gemma4-26B-A4B更强调推理效率与缓存控制。通过混合注意力设计,它在长上下文场景下有效减轻了KV Cache的压力。尽管其推理时仅激活约4B参数,但由于专家路由机制的存在,其对内存的占用仍需参考26B模型的基础标准。

真实能力:Agent编码与通用知识的博弈

在大模型的实际测评中,两者能力分化显著:

- Agentic Coding(智能体编程):这是Qwen3.6的绝对主场。在SWE-Bench Verified等编程基准测试中,Qwen3.6以73.4%的准确率远超Gemma4的52.0%。对于需要频繁调用工具、处理复杂代码流的开发者,Qwen3.6无疑是更强的“生产力工具”。

- 中文理解与通用知识:Qwen3.6在C-Eval等中文榜单上持续领先,展现了深厚的中文语境理解能力。而Gemma4在数学和通用逻辑基准测试(如AIME)中表现强劲,更适合需要稳健推理的学术场景。

部署门槛:显存与算力的实战考量

对于本地部署而言,硬件资源是最大的约束。虽然两者的“激活参数”很小,但必须加载全量模型。

- 显存需求:以4-bit量化为例,Qwen3.6-35B-A3B通常需要约21GB左右的显存,而Gemma4-26B-A4B则更具亲和力,对显存的要求相对较低。

- 推理效率:在RTX4090等主流消费级显卡上,两者均能实现流畅的推理速度。但对于资源极度受限的设备,Gemma4往往能在更小的内存空间内维持高稳定性。

升级建议:你真的需要迁移吗?

如果你是Qwen3.5-35B的老用户,Qwen3.6带来的“思维保留(Thinking Preservation)”特性和更强的Agent协作能力是升级的主要动力。但如果你目前运行的是Qwen3.5-27B且业务逻辑偏向基础对话,迁移带来的工程成本可能大于性能提升。

对于关注人工智能前沿技术的开发者,建议根据以下场景进行选择:

- 如果你是Agent开发者:首选Qwen3.6,其在复杂工具调用和代码生成上的统治力无可替代。

- 如果你是资源受限的极客:Gemma4凭借更低的部署门槛和优秀的上下文处理机制,是更稳妥的选择。

- 如果你追求稳定生产:如果现有工作流已跑通,无需盲目追新,保持现有架构的稳定性往往是商业应用的首选。

Loading...

.png?table=collection&id=cbe6506e-1263-8358-a4d7-07ce62fcbb3f&t=cbe6506e-1263-8358-a4d7-07ce62fcbb3f)