智能体进化新篇章:GenericAgent如何实现Token成本降至十分之一?

type

status

date

slug

summary

tags

category

icon

password

网址

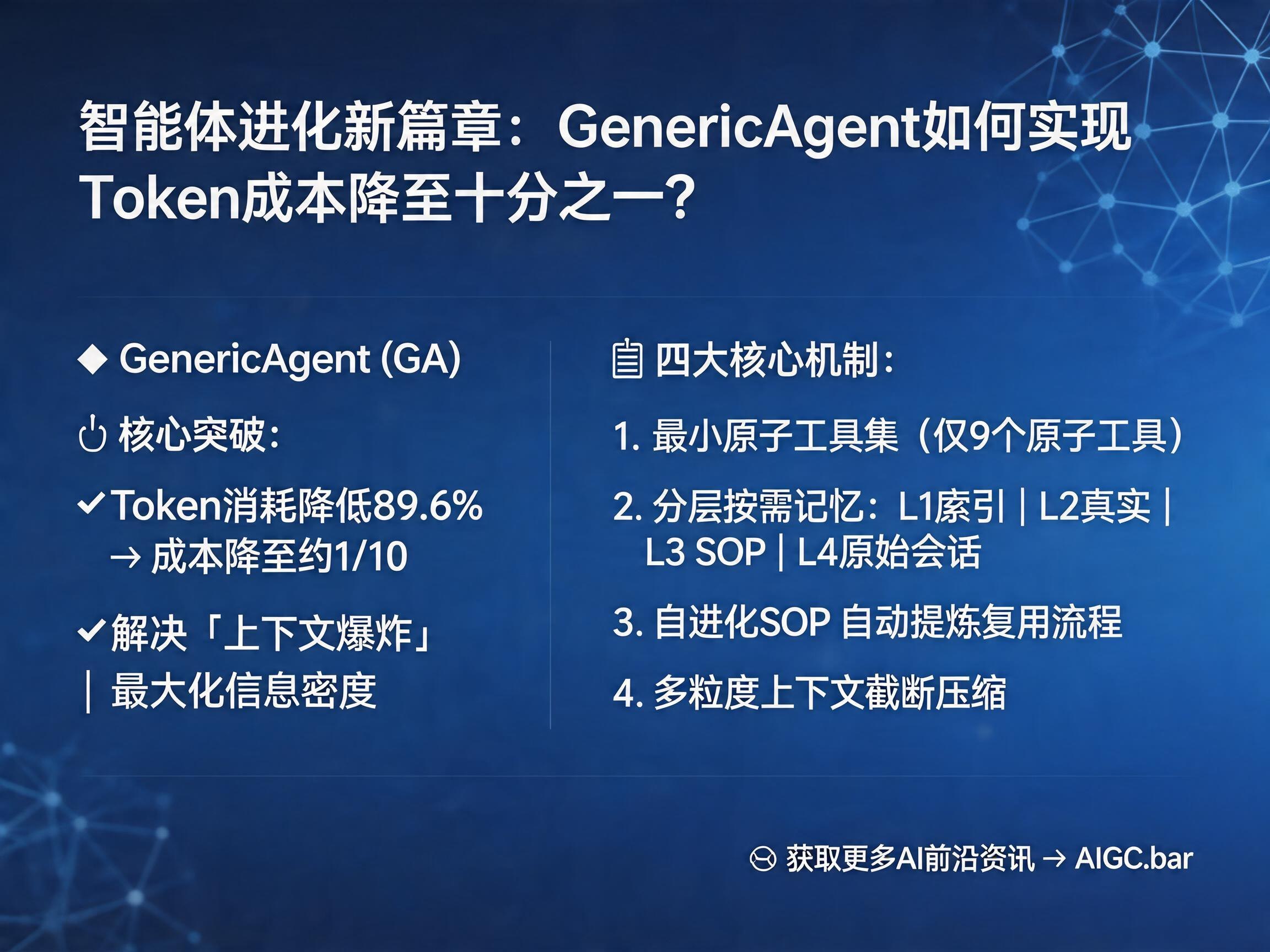

在人工智能飞速发展的今天,我们正见证着从「一次性工具」向「数字同事」的范式转移。然而,许多开发者和企业在部署智能体时,往往面临着上下文爆炸、Token成本高昂以及智能体“记性差”等现实困境。近日,全球首个基于“上下文信息密度最大化”原则的自进化智能体系统——GenericAgent(GA)正式发布技术报告,为行业指明了一条低成本、高效率的进化路径。想要了解更多前沿AI资讯,欢迎访问 AIGC.bar。

重新定义智能体:上下文信息密度才是关键

传统智能体在处理长程任务时,往往陷入“上下文爆炸”的陷阱:随着交互轮数增加,冗余信息不断堆积,导致关键决策信息被稀释,任务准确率大幅下降,且Token消耗呈线性增长。GenericAgent的研究团队指出,长周期性能的决定因素并非上下文长度,而是有限预算内能够维持多少与决策相关的信息。

通过最大化上下文信息密度,GA确保了决策信息的精准提取,并及时剔除冗余内容,从而在根本上改变了智能体的运作逻辑。这一核心洞见,为构建真正高效的 AGI 辅助系统提供了理论支撑。

揭秘GenericAgent的四大核心机制

GenericAgent并非通过堆砌参数来提升性能,而是通过一套精密的架构设计实现了自主进化:

- 最小原子工具集:GA仅保留了9个原子工具。这种极简设计不仅降低了决策成本,还通过工具间的组合泛化,实现了对复杂任务的全面覆盖。

- 分层按需记忆:GA将记忆分为L1索引、L2事实、L3 SOP及L4原始会话四层。系统仅在必要时检索深度信息,确保活跃上下文预算始终被高效利用。

- 自进化机制:系统能够将任务经验自动提炼为可复用的SOP(标准操作流程),实现“越用越聪明”,解决了智能体在不同会话中“重复造轮子”的顽疾。

- 上下文截断与压缩:通过四种不同粒度的修剪机制,GA在保证任务完成率的前提下,将Token消耗压缩至同类系统的15%-35%。

效率与性能的双重胜利

在SOP-bench、Lifelong AgentBench及RealFinBench等权威基准测试中,GenericAgent的表现令人瞩目。它不仅实现了100%的任务准确率,更在重复执行任务时展现出了惊人的效率跃迁。

数据显示,经过多次重复运行,GA的Token消耗可降低高达89.6%。这种从“冷启动”到“快速收敛”的进化模式,证明了GA已经摆脱了对海量 LLM 调用次数的依赖,真正实现了“花小钱办大事”。对于关注 AI变现 和企业降本增效的开发者而言,GA的架构设计无疑具有极高的参考价值。

智能体进化:从学徒到专家的蜕变

GenericAgent的成功证明了权限定义智能体能力的上限。当智能体具备了审视并修改自身架构的能力时,它就从一个被动的执行者转变成了能够自主迭代的数字生命。

在当前的 AI 行业环境下,GA的出现提醒我们:盲目追求模型规模或上下文窗口大小并非唯一出路。通过优化架构设计,提升系统的自进化能力,才是通往更智能、更可靠的 大模型 应用的必经之路。

结语

GenericAgent不仅是一个开源项目,更是一次对智能体设计原则的深刻反思。它证明了即便在有限的算力资源下,通过合理的机制设计,也能打造出具备专家级能力的智能体。

如果您想持续跟踪 AI新闻 和 AI日报 的最新动态,获取更多关于 提示词 优化、openai、chatGPT 以及 claude 的深度分析,请关注 AIGC.bar 这一专业的 AI门户,我们将为您提供最硬核的行业解读。

Loading...

.png?table=collection&id=cbe6506e-1263-8358-a4d7-07ce62fcbb3f&t=cbe6506e-1263-8358-a4d7-07ce62fcbb3f)