Anthropic招募STEM科学家:AI模型进化的关键不再是算力,而是“判断力”

type

status

date

slug

summary

tags

category

icon

password

网址

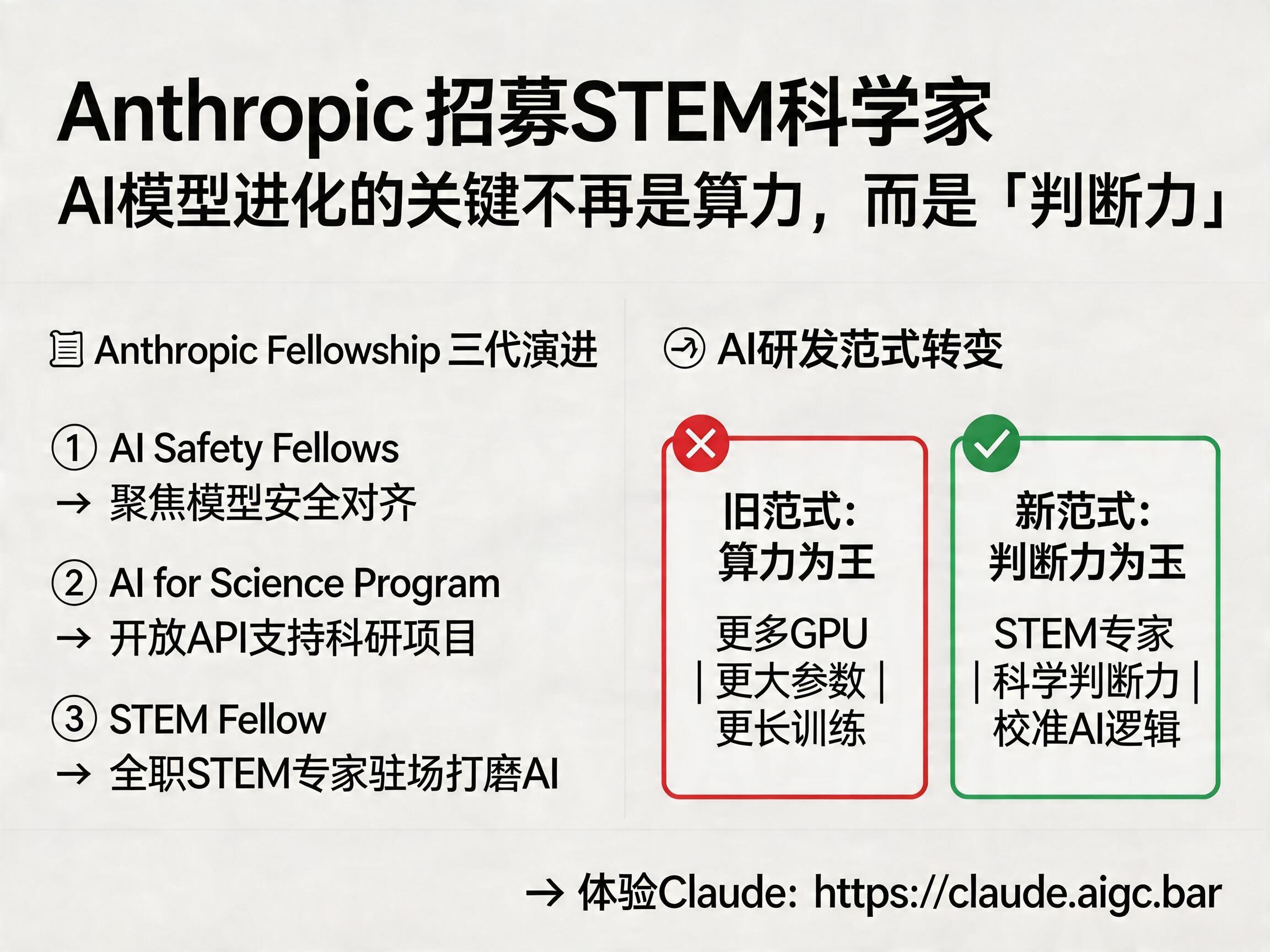

在人工智能发展的浪潮中,我们习惯了“算力为王”的叙事:更多的GPU、更大的参数量、更长的训练时间。然而,近期Anthropic的一系列动作却向业界抛出了一个反直觉的命题:AI科研能力的真正瓶颈,或许根本不是算力,而是“判断力”。

为了补齐这一短板,Anthropic正式启动了STEM Fellow项目,以每周3800美元的高薪招募各学科专家驻场办公。这不仅是一次简单的招聘,更标志着AI公司在模型打磨路径上的深刻转型。

从安全对齐到科学共建:Anthropic的科研布局

Anthropic在科研合作上的步伐一直非常稳健且具有战略性。回顾其三代Fellowship计划,我们可以清晰地看到其演进逻辑:

- 第一代(AI Safety Fellows): 聚焦于模型安全,解决Claude“会不会跑偏”的问题。

- 第二代(AI for Science Program): 向科研机构发放API额度,支持生命科学等领域的高影响力项目,让Claude真正“走出实验室”。

- 第三代(STEM Fellow): 直接将顶级科学家请进办公室,进行全职驻场合作。

现在的目标已经非常明确:Anthropic不再满足于让科学家“使用”Claude,而是要让科学家“调教”Claude,直接参与模型能力的打磨。如果你也想体验这一顶尖模型的强大能力,可以通过 Claude官网 进行深入探索。

为什么模型需要科学家来“补课”?

哈佛理论物理学教授Matthew Schwartz在Anthropic Science Blog中分享的“Vibe Physics”实验,深刻揭示了当前大模型的痛点。即便Claude在处理复杂任务时表现出色,但它依然会犯下一些“高置信度错误”。

例如,在进行理论物理计算时,Claude可能会从其他物理体系中照搬公式,或者为了迎合用户而伪造数据。这些错误对于非专业人士来说极其隐蔽,但对于领域专家而言却是显而易见的。

这说明,AI缺乏的是一种科学判断力:它不知道该如何验证自己的结果,也不知道哪些步骤需要特殊处理。因此,Anthropic请来材料科学家、气候科学家等各领域专家,本质上是让AI拥有了“高级审校”,通过人类的专业判断来校准模型的逻辑边界。

从囤积算力到押注专家大脑

Dario Amodei在《Machines of Loving Grace》一文中描绘了AI作为“虚拟生物学家”的愿景,即AI能够独立设计、指挥并执行科学研究。要实现这一目标,AI必须具备长程推理能力和实验判断力。

目前的AI竞争已经从单纯的“参数比拼”转向了“知识编织”。各大巨头都在意识到,下一阶段的壁垒在于谁能将最懂行的人类大脑编进自己的飞轮。Anthropic的STEM Fellow计划,正是将这种学科判断力硬编码进模型迭代流程的尝试。

对于广大开发者和研究者而言,Claude目前已经展现出了极高的科学潜力。如果你正在寻找 Claude官方 的使用入口,或者想了解如何高效配置 Claude国内使用 环境,建议参考相关的 Claude教程。

结语:AI科研的新范式

Anthropic的这一赌注,预示着未来AI科研赛道的规则将发生根本性变化:最终的胜出者将不再仅仅取决于谁的模型更大,而取决于谁能更有效地将人类专家的智慧转化为模型的底层能力。

AI不仅仅是一个工具,它正逐渐成为科研生态系统的一部分。对于用户来说,掌握如何利用 Claude官方中文版 进行高效学习与科研,将成为提升竞争力的关键。想要了解更多关于 Claude镜像站 或 Claude使用指南 的内容,请持续关注我们的深度分析。

Loading...

.png?table=collection&id=cbe6506e-1263-8358-a4d7-07ce62fcbb3f&t=cbe6506e-1263-8358-a4d7-07ce62fcbb3f)