Claude真的降智了吗?深度解析模型“变笨”背后的真相

type

status

date

slug

summary

tags

category

icon

password

网址

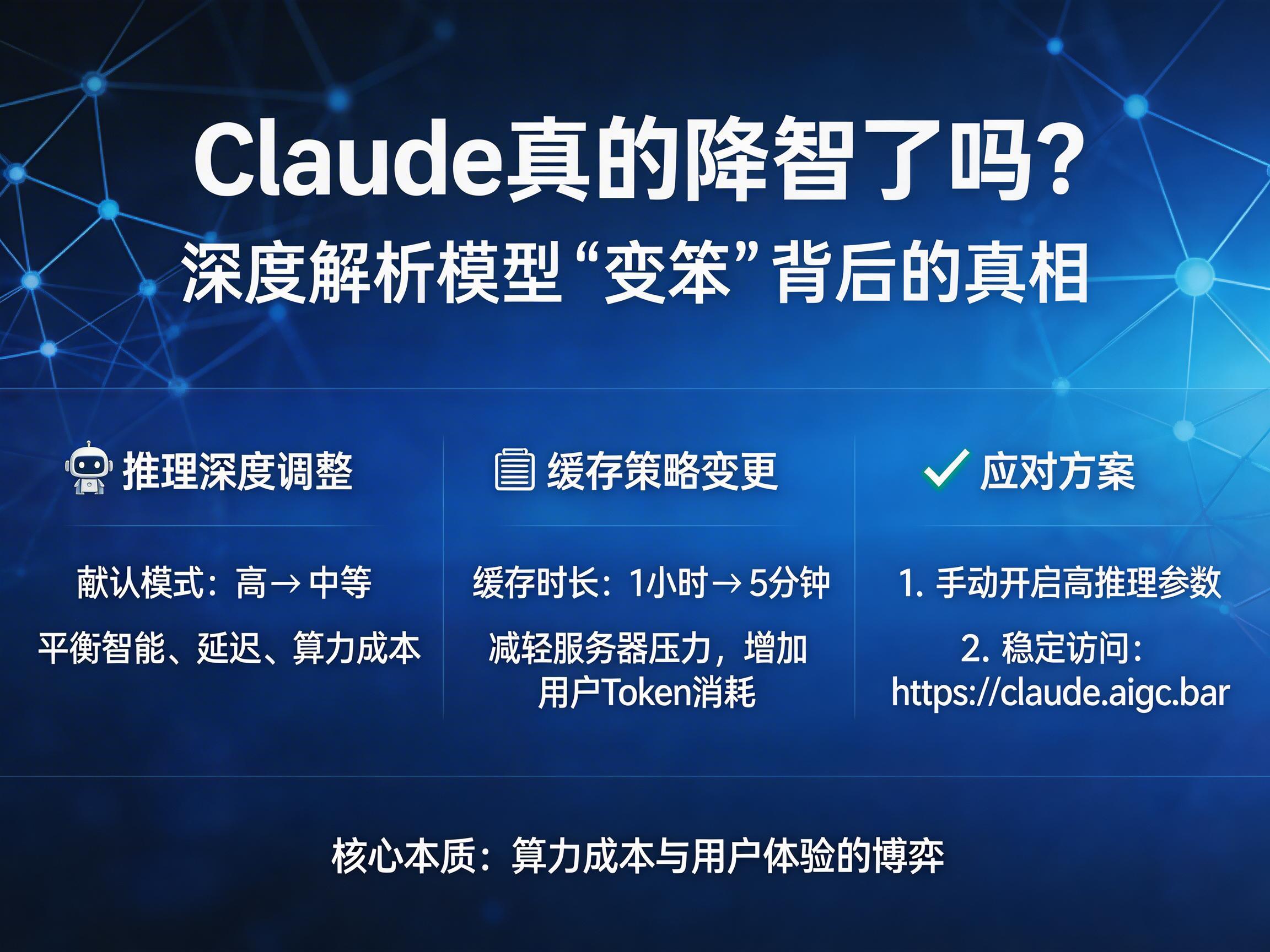

近期,关于“Claude降智”的讨论在技术社区和社交媒体上引发了轩然大波。许多重度用户反馈,Claude Opus 4.6在推理深度、逻辑准确性以及任务执行力上表现大不如前,甚至出现了频繁“偷懒”、拒绝执行复杂任务的情况。面对用户的质疑,Anthropic官方虽多次否认故意削弱模型能力,但“降智”现象背后的技术逻辑依然值得我们深入拆解。

所谓降智:是模型变笨还是策略调整

从技术角度来看,所谓的“降智”往往不是模型权重的直接降级,而是工程策略调整的结果。近期Claude Code负责人Boris Cherny的回应揭示了核心原因:为了平衡智能水平、响应延迟与算力成本,Anthropic调整了模型的“自适应思维”默认模式。

简单来说,系统不再默认调用最高推理深度,而是将默认值调整为“Medium(中等)”。这种调整虽然在官方看来是性能与成本的最佳平衡,但对于习惯了高强度推理的用户而言,直观感受就是“模型变懒了”。如果用户有更高的需求,可以通过设置参数来手动强制开启高推理深度,但这无疑增加了普通用户的上手门槛。

工程视角的“缩水”:缓存与API策略

除了推理深度的调整,另一个引发用户不满的原因是缓存机制的变更。有数据分析显示,Claude Code的提示词缓存有效时长从1小时大幅缩短至5分钟。这一改变虽然极大减轻了服务器的存储压力,但导致长会话中缓存频繁失效,用户不得不承担更多的Token消耗。

这种从用户体验向基础设施成本倾斜的策略,是目前所有大型大模型服务商面临的共同困境。当用户习惯了高质量的交互,任何为了节省算力而进行的“优化”,都会被用户敏锐地捕捉并解读为“降智”。

如何在变动中获取更稳定的体验

面对大模型版本迭代和策略调整带来的不确定性,用户应该如何应对?首先,对于专业用户而言,掌握API参数调优是关键,了解如何通过指令强制模型进入“深度思考”模式至关重要。其次,选择稳定可靠的访问渠道也是保障使用效率的核心。

如果您在日常工作中对模型的稳定性有较高要求,建议关注优质的资源整合平台。您可以访问 Claude官网 获取最新的使用技巧与稳定访问方案。无论您是寻找 Claude国内使用 的解决方案,还是需要可靠的 Claude镜像站 进行测试,了解这些工具的配置方法都能帮助您绕过部分不必要的延迟和策略限制。

总结与展望

Claude的“降智”风波,本质上是AI算力成本与用户体验之间的一次博弈。对于开发者和企业用户来说,这提醒我们不能过度依赖单一模型的默认行为,而应通过更精确的Prompt工程和API参数控制来驾驭模型。

随着大模型技术的不断演进,像Claude这样的一流模型必然会经历频繁的架构更新。保持对 Claude官方中文版 的关注,并参考专业的 Claude教程,将是每一位AI从业者必修的功课。掌握了这些 Claude使用指南,即便面对模型的策略波动,您依然能够从容应对,发挥出AI的最大价值。

Loading...

.png?table=collection&id=cbe6506e-1263-8358-a4d7-07ce62fcbb3f&t=cbe6506e-1263-8358-a4d7-07ce62fcbb3f)