黄仁勋100万亿预言兑现!易鑫Voice Agent落地...

type

status

date

slug

summary

tags

category

icon

password

网址

Voice Agent终于能打实战了!这家中国公司靠一套Model + Harness的方法论,正在重新定义金融级Agent的标杆,也撬动了黄仁勋所预言的百万亿美元市场。

Voice Agent赛道,从来不缺故事。

2024年,GPT-4o横空出世,全球科技圈集体高潮——「AI终于会说话了」。

紧接着,数以百计的Voice Agent创业公司如雨后春笋般冒出,融资消息一个接一个。

硅谷的投资人们画了一个万亿级的大饼:AI语音智能体将重塑一切电话交互场景。

但到了2026年,画风变了。

绝大多数通用Voice Agent,在实验室里表现惊艳,到了真实业务里却频频翻车——

听不懂方言、扛不住噪音、一被打断就「逻辑崩盘」、合规红线踩了又踩。

尤其是金融、保险、医疗这些更复杂、专业的场景,通用方案几乎集体哑火。

就在行业还在纠结「Voice Agent到底能不能用」的时候,一家中国公司给出了答案。

通用方案水土不服,垂类需要「场景原生」

深耕汽车金融11年的易鑫,没有去追「通用AI」的风口,而是扎进了最难啃的垂类场景。

为此,他们自研了一套「工业级」Voice Agent系统。

它集Multi-Agent协同架构、Turn-Taking模型、场景降噪引擎和多语言TTS大模型于一体。

要理解易鑫Voice Agent的价值,首先要理解一个残酷的现实:通用AI方案在汽车金融面前几乎是「裸考」。

业内大厂Voice Agent方案,大多是追求普适性与标准化——

在通用场景可以快速落地,但对汽车金融这类链路复杂、合规严苛、业务节点密集的垂直场景,适配度始终不足。

更现实的问题是,通用方案追求「播音员级」的优美音色,侧重听觉体验,本质是「体验优先」。

但在电销场景里,一个声音好听但没有「人味」、不懂业务的AI,反而让客户秒挂。

易鑫的做法截然不同。

在表层,他们选用贴合车主沟通习惯的音色,适配方言场景;

但在深层,真正让客户不挂电话的,是Agent不仅兼顾了亲和力与合规严谨性,还学会了老电销那种「先共情再办事」的对话直觉。

核心目标只有一个:优化客户体验,提升转化率,实现「业务优先」的价值闭环。

这就是「通用适配」和「场景原生」的根本区别。

前者在试图让一把万能钥匙打开所有锁,后者在为每一把锁量身打造钥匙。

把自由聊天,变成「精密流水线」

易鑫Voice Agent最核心的技术突破,是其基于文本的Multi-Agent协同架构。

这里有一个行业背景需要交代:目前绝大多数企业,哪怕是最简单的单Agent方案,都不敢直接推上生产环境。

原因很简单,通用Agent可控性差、工具调用不稳定、任务容错率低。

一旦模型「自由发挥」,在金融合规场景里就是灾难。

易鑫的解法是:把一通复杂的销售电话,拆解成多个高度专注的「小任务」,分配给不同的Agent专项处理。

具体而言,系统部署了四大Agent板块:问候与结束、资质确认、添加微信、咨询问答。

每个Agent专注处理一个细分任务。这套架构的精妙之处,在于以下三个「硬核」设计:

第一,一个任务节点只管一件事。

汽车金融场景真实的电销SOP包含身份确认、需求确认、资质确认、添加微信等一系列递进环节。

如果把所有规则塞进一个巨大的Prompt里,大模型会瞬间「过载」,极易出现幻觉——不知道先干啥、容易听错话、或被客户一句话带偏。

所以易鑫的做法是:把整个流程切成一个个任务节点。

每个任务节点只负责一件事,并且拥有独立的指令、话术示例和工具集,AI被严格限定在当前任务范围内——达不成目标,就无法进入下一个任务节点。

第二,流程走到哪一步,系统说了算。

一般来说,传统做法是让LLM自己判断「接下来该干什么」,比如输出「关键词」决定流程走向。

但这种方式极其脆弱,AI一旦「想岔了」,整个对话就跑偏了。

为此,易鑫专为流程流转上一把「物理锁」。具体来说:

每个任务节点完成后,Agent输出了符合格式要求的结果,才会被视为正确的「交接信号」,流程才能往下走。

不仅如此,系统在启动时,就会强制校验所有任务节点之间的跳转关系是否真实存在。

如果某个节点指向了一个根本不存在的下游环节,直接报错拦截。

AI想「自由发挥」,系统根本不给它机会。

第三,用户打断时,AI不会「记混」。

电话里用户随时可能打断插话,这是常态。但对AI来说,这是个大麻烦。

普通单体文本Agent会把所有生成内容塞进记忆,导致后续业务逻辑错乱。

易鑫的处理方式是,对话记录不由模型自己管,而是交给外部框架统一管理——

当用户打断时,系统只保留用户实际听到的那部分内容,再追加用户的新输入。

这样,当流程从「破冰问候」推进到「资质确认」时,下一个任务节点拿到的对话记录是干干净净、完整还原真实通话的,不会因为中途被打断就记串了。

Multi-Agent协同架构把电销从「不可控的自由对话」,变成了可追溯、可质检、可合规、可复制、可运营优化的SOP。

这才是Agent能进核心业务的前提。

让AI选择性失聪,掌握「说话的艺术」

如果说Multi-Agent架构是「大脑」,那降噪引擎和Turn-Taking模型就是「耳朵」和「嘴巴」。

要让AI打好一通电话,第一步是听得清,第二步才是接得住。

先说「听」,降噪引擎要解决的,是让AI学会「选择性失聪」。

真实电销场景里,客户可能在地铁上、马路边,甚至嘈杂的工地里接电话。

背景噪音经常让AI产生「幻听」:鸣笛声、他人交谈声被错误识别为客户指令,产生大量「无效轮次」(Noise Rounds),直接干扰AI的决策逻辑,导致Voice Agent频繁「乱插话」或「答非所问」。

易鑫AI团队上线的场景适配降噪引擎,在两个关键维度实现了突破:

低信噪比噪音消除率80%,将嘈杂环境的压力分散到降噪模型,在最低限度损伤音频的情况下,处理好绝大部分干扰AI决策的噪音。

同时,通过语义保真算法,确保主说话人的语音特征完美保留,ASR识别准确率不降反升。

听清楚了,下一个问题是:什么时候该开口?

这正是Turn-Taking要解决的「对话节奏」问题。

在真实电话场景中,每个人的说话习惯千差万别:有人语速极快,有人说一半停下来想想再继续。

传统方案,AI要么在人还没说完时就插嘴抢,要么人说完了半天没反应,两种体验都让人想挂电话。

为此,易鑫自研的Yx-Turn预测模型,核心任务只有一个:判断客户到底说完了没有。

它同时听两样东西。

一是声学信号,包括客户的语气、停顿、拖音等。

二是语义理解,比如客户说的话里有没有「嗯…我想一下」、「那你看这样行不行」这类未完待续的意思。

模型将每轮会话的交互状态分为三种:发言结束(EOT)、继续发言(CT)和挂起等待(WAIT),并通过三阶段演进式数据构建策略,逐步从「不抢话」进化到「读懂意图」。

举个例子,当用户说「等一下」时,系统识别为挂起状态,回应「好的,不着急」,保持收音不中断,同时继续等待客户后续发言。

更值得一提的是框架层的「兜底策略」。在全双工对话中,用户随时可能打断AI。

易鑫采用了创新的消息合并策略:将未完成消息暂存至缓冲区,设置观察等待期,若用户继续表达,系统自动合并新旧消息,确保LLM基于完整上下文推理;若识别为无意发声或噪声,则自动过滤。

这彻底解决了传统方案中「用户一打断,AI就失忆」的尴尬。

这套机制还解决了行业公认的「幽灵回复」(嗯、额、啊等语气词)难题,系统能精确区分用户是在随声附和,还是在给出答复,不再因误判导致逻辑跳步或抢话。

这项技术听起来不够「性感」,但在电销场景里,它直接决定了用户愿不愿意继续听下去。

用易鑫高级算法工程师的话说,「我们的目标不是训练一个技术最牛的模型,而是训练一个最懂易鑫业务的模型」。

这种务实到骨子里的技术哲学,恰恰是易鑫Voice Agent能跑通生产环境的底层原因。

横扫多种语言,剑指全球市场

Voice Agent的最后一块拼图,是语音合成(TTS)。

基于覆盖全国340余个城市的业务网络,易鑫自研TTS大模型已全面适配普通话,同时支持四川、天津、东北、河南、广东、福建、湖南等多地主流方言。

更值得关注的是全球化布局。

易鑫TTS已支持英语、西班牙语、葡萄牙语等主流语言,并针对日本、马来西亚、新加坡、澳大利亚、墨西哥、巴西等核心出海市场进行了深度本地化定制,兼容多个小语种及变体,可覆盖全球大部分主流汽车金融商业化语音场景。

这一成绩离不开易鑫在技术层面的深耕。

为还原真人般的声音,易鑫搭建了三层语音数据体系——标准语音数据、真实口语数据和专业录音数据,让模型听足够多样、真实的声音。

为深度贴合汽车金融业务特性,模型对专属场景、专业术语、业务话术做了专项调优,使音色、情感、语调、语速和本土化适配等效果全面升级。

在训练策略上,团队引入GRPO强化学习方法进行后训练:

从内容准确性、音色还原度、情感表现力、听感自然度这四个维度由「AI评委」对合成的语音进行打分(奖励),最后会汇总成一个综合奖励信号,驱动模型持续进化。

模型学会的不只是「怎么说」,而是什么时候、以什么方式说,才最契合人类的情感逻辑。

Model + Harness,

一套真正能打的Voice Agent方法论

如果把上述技术能力拆开来看,每一项都有不少公司在做。

但易鑫Voice Agent真正的差异化,在于它背后的一套完整方法论:Model与Harness的深度结合。

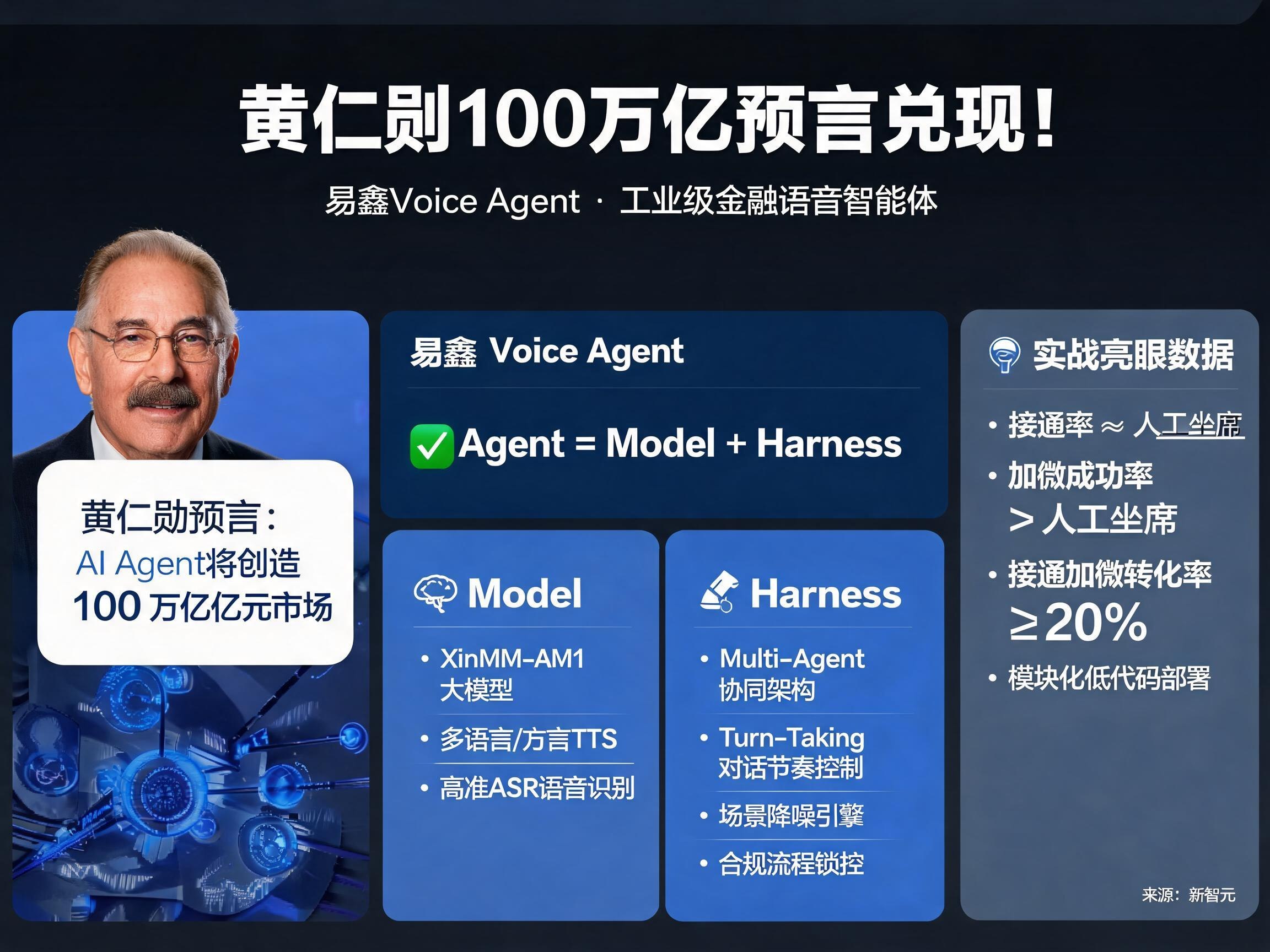

英伟达CEO黄仁勋曾预言,AI Agent等AI技术将创造100万亿美元的市场。

但预言要落地,便需要这个关键公式:Agent = Model + Harness。

所谓Model,是指大模型本身的能力:语义理解、意图识别、文本生成、语音合成。这是AI系统的「智力」。

所谓Harness,则是约束、驾驭和编排模型能力的工程化架构:结构化状态机、防幻觉协议、外部记忆管理、合规流程门控、工具调用治理。这是AI系统的「纪律」。

Loading...

.png?table=collection&id=cbe6506e-1263-8358-a4d7-07ce62fcbb3f&t=cbe6506e-1263-8358-a4d7-07ce62fcbb3f)