MiniCPM-V 4.6:1B模型如何颠覆端侧AI新格局

type

status

date

slug

summary

tags

category

icon

password

网址

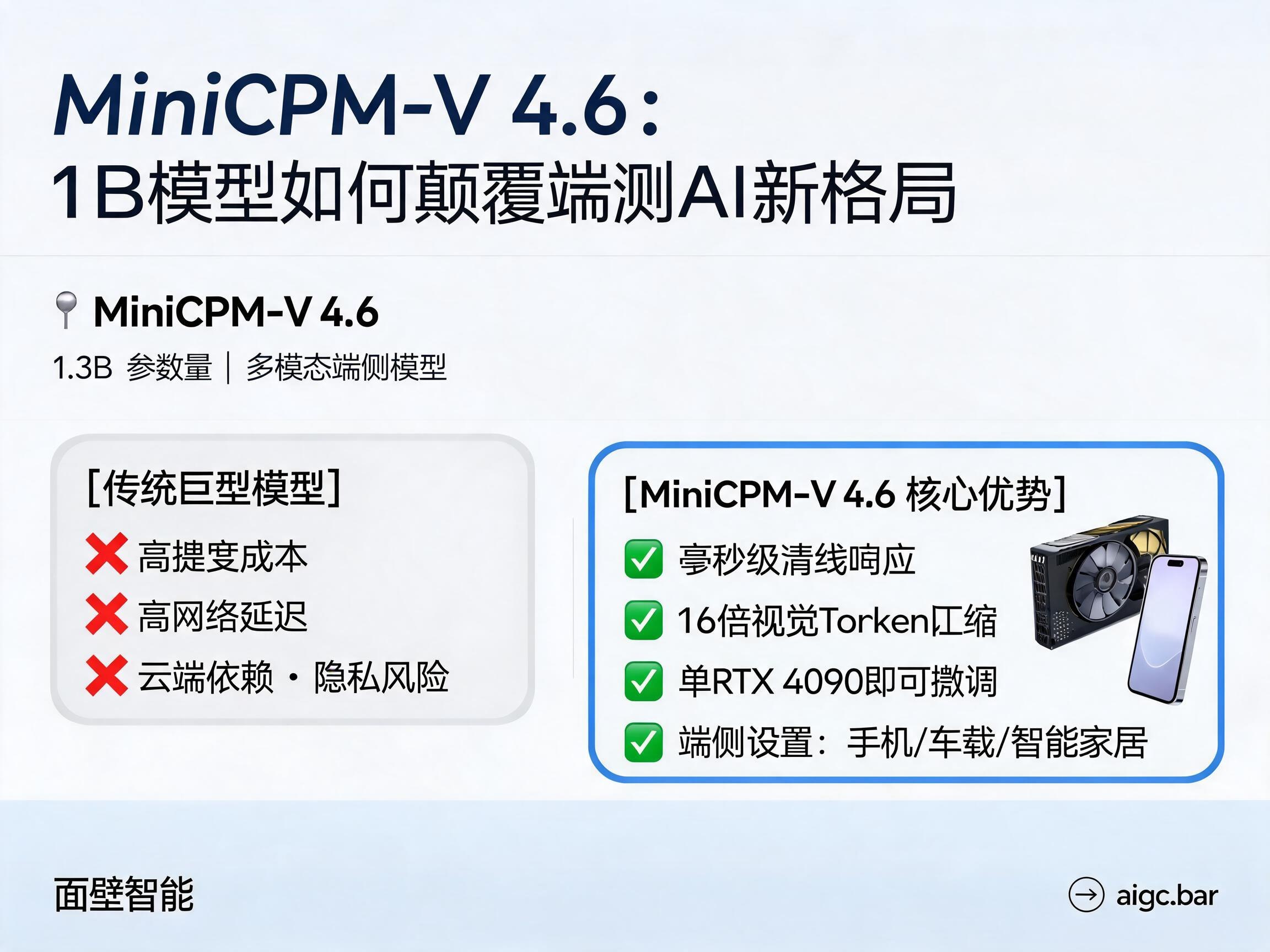

在人工智能飞速发展的今天,我们常常被动辄千亿、万亿参数的“巨无霸”模型所吸引,认为模型规模越大,其智能水平就越高。然而,这种“唯参数论”的思维模式,在AI大规模落地的过程中,逐渐暴露出其固有的短板:高昂的推理成本、不可控的网络延迟以及严苛的数据隐私风险,让AI的普惠化成为一道难以逾越的鸿沟。正是在这样的背景下,我们看到了一个反常识却又充满潜力的演进趋势——参数规模更小的模型,在特定场景下正爆发出惊人的效率与性能优势。

面壁智能近日开源的MiniCPM-V 4.6模型,正是这一趋势下的杰出代表。这款参数量仅为1.3B(约10亿)的多模态基础模型,不仅在性能上超越了同尺寸的标杆模型,更在推理效率和部署便利性上树立了新的标杆,为AI的端侧落地和成本优化提供了强有力的解决方案。

端侧AI的“不可能三角”与1B模型的价值

传统的AI模型落地面临着“性能、时效、并发”组成的“不可能三角”。大型模型虽然性能强大,但推理成本高、延迟大,难以满足实时交互和海量并发的需求。而完全追求轻量化,又可能牺牲模型在复杂任务上的表现。

然而,真实世界的业务场景需求正在打破这一僵局。在诸如智能手机、汽车、智能家居等终端设备上,AI需要具备:

* 毫秒级离线运行:无需联网,保护用户隐私。

* 低延迟意图识别:应对千万级并发请求,提供即时响应。

* 高效的辅助任务处理:如RAG系统中的智能路由、数据清洗,以及信息提取、格式转换等,要求模型“专精且准确”。

在这些场景下,1B参数量的模型展现出其独特的价值。它们体积小巧,部署灵活,能够承担起最基础但至关重要的任务,并且在特定任务上的表现,经过微调后甚至能超越参数量大得多的模型,几乎做到“零幻觉”。从阿里的Qwen3.5-0.8B到谷歌的Gemma 4 E2B-it,轻量级LLM正在快速接管那些追求“快、稳、省”的辅助性AI任务。

MiniCPM-V 4.6:1B参数的“端侧第一”实力验证

面壁智能发布的MiniCPM-V 4.6,在1B参数量级别上,交出了一份令人惊艳的答卷。它不仅在视觉理解和语言交互方面表现出色,更在多模态综合能力上超越了同尺寸的竞品,实现了“尺寸更小、效率更高、性能更好”的目标。

卓越的多模态综合能力

在业内公认的各项评测基准中,MiniCPM-V 4.6都展现出了远超其模型规模的“智能密度”。

* 超越标杆:它全面超越了被视为1B级别多模态模型标杆的Qwen3.5-0.8B,在大部分图文理解任务上取得了更优异的成绩。

* 极致的Token利用率:在一个权威的评测体系中,MiniCPM-V 4.6仅用了Qwen3.5-0.8B约2.5%的Token吞吐量,就取得了超越后者的性能。这表明模型对上下文信息的高效利用能力极强,对于端侧模型而言是至关重要的特质。

极致的推理效率与成本优势

对于云端高并发场景和算力受限的终端硬件而言,推理速度和吞吐量是核心指标。MiniCPM-V 4.6凭借其核心技术——16倍视觉Token压缩,在RTX 4090等消费级显卡上,实现了惊人的实测表现:

* 首字响应延迟(TTFT)极低:处理高达3136²分辨率的超高清大图时,首响仅需75.7毫秒,比同基座规模的Qwen3.5-0.8B快2.2倍。这意味着用户在4090显卡上处理4K图片提问时,几乎可以实现“秒回”。

* 高并发吞吐量亮眼:在输出200 token的设定下,RTX 4090单卡处理1344²分辨率图片时,吞吐量可达2624 token/s,相当于每秒处理14.3张图片,是Qwen3.5-0.8B的1.4倍。这意味着同样的硬件部署MiniCPM-V 4.6,可以承载数倍的线上业务流量。

这些数据共同指向一个结论:MiniCPM-V 4.6通过更短的视觉序列和更小的KV-Cache占用,将端侧体感与云侧投资回报率(ROI)同时推向了新的高度。在实际移动端设备(如iPhone 17)上的演示也印证了这一点:无论是识别物体、处理复杂的文字提取或翻译,模型都能在毫秒级实现“零预热”的秒回响应,真正将AI融入设备“血液”。

技术内核:LLaVA-UHD v4架构的创新之道

MiniCPM-V 4.6之所以能在极小的参数量下爆发出惊人的效率,其背后的技术逻辑是关键。这得益于面壁智能与清华大学团队联合研发的第四代LLaVA-UHD (v4)架构,它解决了高分辨率图像处理中的视觉编码效率难题。

创新一:ViT内部视觉Token“早压缩”

主流的高分辨率图像处理方案通常采用全局编码,但计算开销会随着分辨率呈二次方增长。LLaVA-UHD v4首先采用切片编码规避了算力膨胀。更重要的是,它将压缩动作前置,在ViT(Vision Transformer)的浅层就引入了高效的压缩模块。

通过巧妙地引入窗口注意力机制和复用预训练ViT层的参数,实现了对视觉表征的最小扰动,使得视觉Token压缩能够稳定前移。这一架构创新,将视觉编码阶段的浮点运算量暴降55.8%,同时保持了下游任务的性能不掉点,显著降低了图像编码的开销。

创新二:4倍/16倍混合视觉Token压缩率

视觉Token的压缩率直接影响显存占用、延迟、吞吐量和功耗。MiniCPM-V 4.6实现了“鱼与熊掌兼得”:

* 4倍压缩模式:提供极致性能和高精度,适合细粒度视觉解析。

* 16倍压缩模式:速度飞快,吞吐量爆表,特别适合算力受限的终端硬件和高并发的云端工业场景。

16倍压缩率的价值已在快手等真实工业案例中得到验证,证明了MiniCPM-V系列在高并发工业场景下的可用性和成本优势。

“保姆级”基座:一张4090即可“爆改”

一个开源模型的生命力,不仅在于其技术实力,更在于其是否易于开发者使用和落地。MiniCPM-V 4.6提供了从微调到部署的“保姆级”二次开发基石,旨在让开发者能够轻松“爆改”。

打破算力壁垒:消费级显卡即刻开跑

传统的模型微调往往需要昂贵的A100/H100算力集群。但MiniCPM-V 4.6凭借其1B的精简参数量,将定制微调的门槛大幅降低。开发者仅需一张RTX 4090等消费级显卡,就能完成完整的微调流程,在本地PC上验证想法、定制垂类场景模型,无需巨额算力预算。

拥抱主流生态:微调与推理全链路打通

为了让开发者摆脱环境配置的困扰,MiniCPM-V 4.6与主流开源工具链实现了无缝对接:

* 微调框架原生支持:深度适配ms-swift、LLaMA-Factory等流行框架,提供中英双语CookBook教程,实现一键拉起专属模型的训练。

* 推理框架全家桶兼容:支持vLLM、SGLang(云端极致并发),以及llama.cpp、Ollama(轻薄本、Mac、手机端侧CPU/端侧推理)。

凭借极低的显存占用、高并发吞吐量和完备的工具链,MiniCPM-V 4.6成为构建高并发、极速响应多模态应用的高性价比首选。

端侧“长期主义”:MiniCPM-V家族的演进之路

MiniCPM-V 4.6的成功,是面壁智能在端侧多模态领域多年持续积累的成果。回顾其发展历程,可以看到一条以“智能密度”为核心的清晰脉络:

- MiniCPM-V 2.0 (2.8B):确立“以小博大”基调,在7B以下模型中表现靠前。

- MiniCPM-V 2.5 (8B):支持30+语言,OCR成绩SOTA,综合性能超越GPT-4V。

- MiniCPM-V 2.6 (8B):首次支持单图、多图、实时视频推理,量化后仅需6G内存。

- MiniCPM-V 4.0 (4.1B):参数减半但性能提升,专为移动端优化。

- MiniCPM-V 4.5 (8B):行业首个具备高帧率视频理解能力模型,支持最高10 FPS长视频解析。

从2.0到4.6,MiniCPM-V系列不断拓展端侧模型的能力边界,并在联想、吉利、上汽大众等企业实际业务中落地。其关于“密度定律”的研究成果也发表于国际顶级期刊《Nature Communications》,并获得国际学术界的认可。

结语:AI普惠化的新篇章

面对云端巨型模型的轰炸,我们不应陷入唯参数论的迷思。AI的真正价值在于融入人类生活的每一个角落,而非仅仅停留在机房。MiniCPM-V 4.6以其1B参数的体量,通过架构优化和Token压缩技术,在性能、速度、成本和易用性上实现了全面突破,它不再是一个简单的技术Demo,而是加速边缘计算生态爆发的强劲催化剂。

大厂之所以争相布局端侧模型,是因为未来属于边缘侧。而面壁智能及其MiniCPM-V家族,正以中国架构的创新力量,在这条通往“智周万物”的道路上,刻下深刻的印记。

更多AI资讯,尽在aigc.bar。

Loading...

.png?table=collection&id=cbe6506e-1263-8358-a4d7-07ce62fcbb3f&t=cbe6506e-1263-8358-a4d7-07ce62fcbb3f)