别给大模型加高级词!陆弘远团队ACL新作揭秘AI更爱大白话

type

status

date

slug

summary

tags

category

icon

password

网址

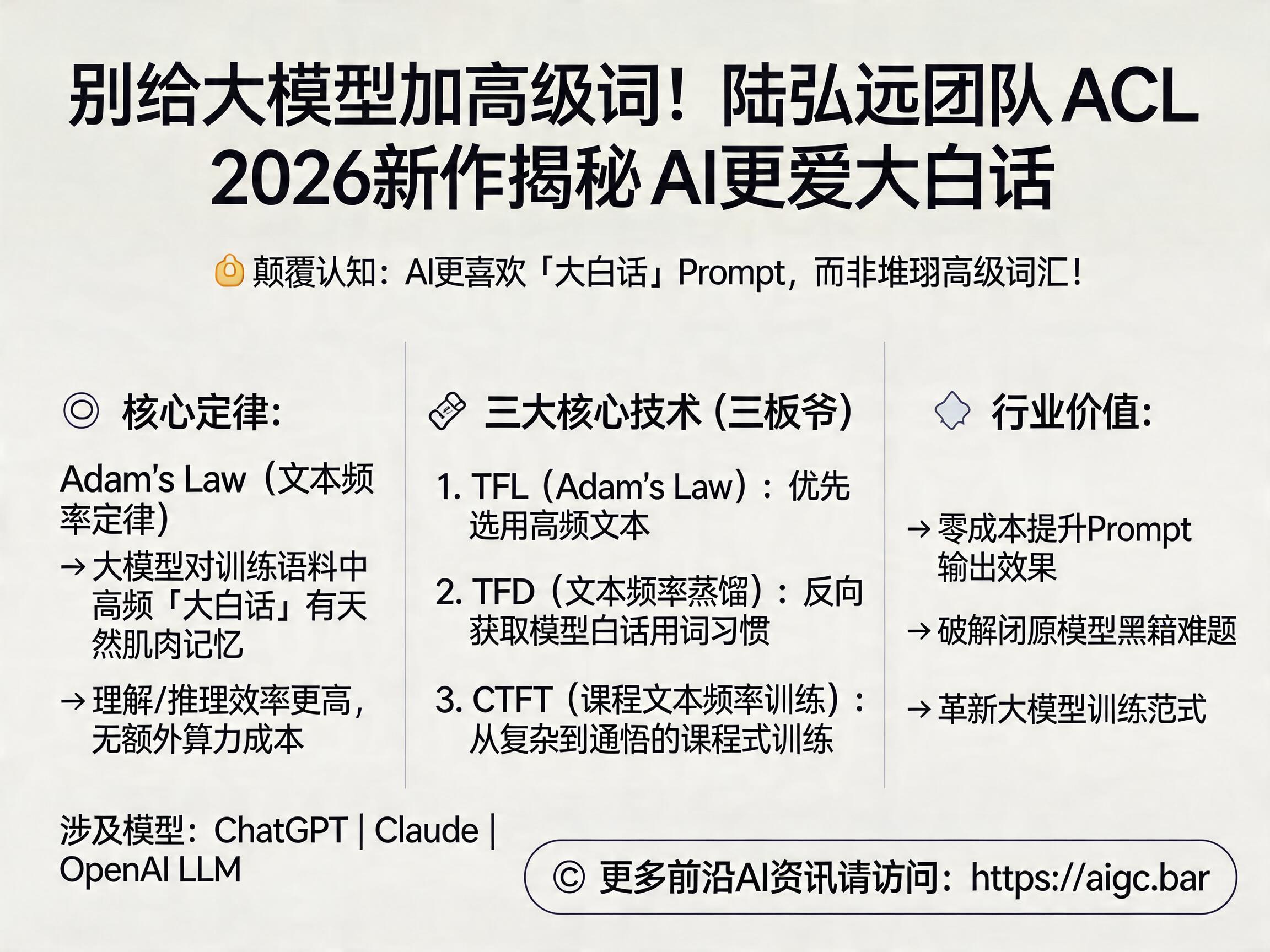

在日常使用chatGPT或claude等大模型时,很多用户为了获得更好的输出,会在提示词(Prompt)中堆砌大量的高级词汇和复杂的长句。然而,最新的AI资讯打破了这一常规认知。脸谱心智(FaceMind)CEO陆弘远团队与香港中文大学联合发表了一项中稿ACL 2026的主题研究,提出了极具颠覆性的“Adam's Law”(文本频率定律)。研究表明:别再给模型叠加“高级词”了,人工智能更爱听“大白话”!关注最新的AI新闻和AI日报,请访问专业的AI门户。

什么是Adam's Law(文本频率定律)?

在LLM的圈子里,一直存在一种“玄学”:同一个Prompt,仅仅换个说法,模型的回答质量可能就天差地别。陆弘远团队深入挖掘了这一现象,提出了Adam's Law,即文本频率定律。该定律指出,当不同表述表达同一个意思时,语言模型往往更偏好“高频文本”。

简单来说,决定一个大模型是否聪明的,不仅在于“你问了什么”,更在于“你是怎么问的”。因为高频表达在AGI的训练语料中出现的次数足够多,模型对它们有着天然的“肌肉记忆”。面对这些熟悉的“大白话”,模型在理解、推理和生成时更容易零百进入状态。这为我们日常优化openai等模型的提示词提供了全新的思路。

破解黑箱:让模型说大白话的“三板斧”

为了将这一理论落地,研究团队不仅提供了严密的数学推导,还搭建了一个完整的框架,包含三项核心技术:

- TFL(Adam’s Law):确立了“高频文本应被优先选择”的基础定律。

- TFD(文本频率蒸馏):针对闭源模型训练数据未知的难题,通过让目标模型进行“故事续写”,反向修正频率估算。这就好比让模型自己暴露潜意识里的用词习惯,从而无限逼近模型内部真正熟悉的白话表达分布。

- CTFT(课程文本频率训练):在模型训练阶段,把文本频率引入课程学习,像教人类一样,先让模型学习低频复杂的“文言文”,再学习高频通俗的“白话文”,从而获得比随机喂数据更好的收敛效果。

这套方法极其接地气,绕开了闭源大模型的黑箱限制,把AI变现和工程落地中的玄学推进到了可验证、可复现的工程层面。

从Prompt优化到模型训练的全面革新

Adam's Law最绝的一点在于,它不仅是一个讨巧的Prompt技巧,更是直接杀入了硬核的模型训练范式中。

在推理(Inference)阶段,逻辑非常顺滑:如果我们把提示词里的生僻词换成大白话的高频表达,模型的数学推理、机器翻译和常识解析能力会显著提升,而且不需要增加任何算力成本和推理时长。

在训练(Training)阶段,Adam抛出了一个灵魂拷问:如果算力预算有限,训练数据该怎么挑?研究表明,高频文本可能比低频文本更值得优先保留。实验发现,有时候用高频改写的数据去训练模型,效果甚至超越了原始的基准训练集。这直接挑战了人工智能业内“原始数据天然最优”的传统偏见。

Adam's Law对AI行业的三大启示

这项研究为整个AI行业带来了深远的影响和启发:

- 对于AI应用开发者:别再给Prompt疯狂加毫无必要的定语、约束和高端词汇了。把提示词理顺,改得更自然、更高频,这可能是一种几乎没有成本、见效极快的魔法。

- 对于模型炼丹师:这提供了全新的数据工程(Data Engineering)治理思路。在清洗LLM训练数据时,除了看数据的质量、长度和难度,还需要给文本频率做画像。当GPU吃紧时,留什么数据还得看看这句话是不是足够的“大白话”。

- 对于AI评测研究者:如果一道题换个冷门说法模型就不会做了,那它究竟是真的具备了推理能力,还是仅仅靠着刷题记住了特定表述的熟悉度?这为未来构建更抗造的评测榜单敲响了警钟。

结论

Adam’s Law像一面镜子,照出了大模型的本质:它不仅在理解世界,更是在记住人类语言世界里什么东西最常出现。当整个AI圈都在为了更庞大的参数量和更玄乎的对齐算法内卷时,这项研究指出了一条无比朴素的捷径——让模型变聪明的秘诀,就是把话说得更“大白话”一点。无论是日常使用chatGPT、claude,还是进行底层模型训练,这都将成为一条极具指导意义的准则。想要获取更多前沿的AI资讯、AI新闻以及大模型使用技巧,欢迎访问专业的AI门户。

Loading...

.png?table=collection&id=cbe6506e-1263-8358-a4d7-07ce62fcbb3f&t=cbe6506e-1263-8358-a4d7-07ce62fcbb3f)