AI新突破:北大CPL++赋能视觉定位“自知之明”

type

status

date

slug

summary

tags

category

icon

password

网址

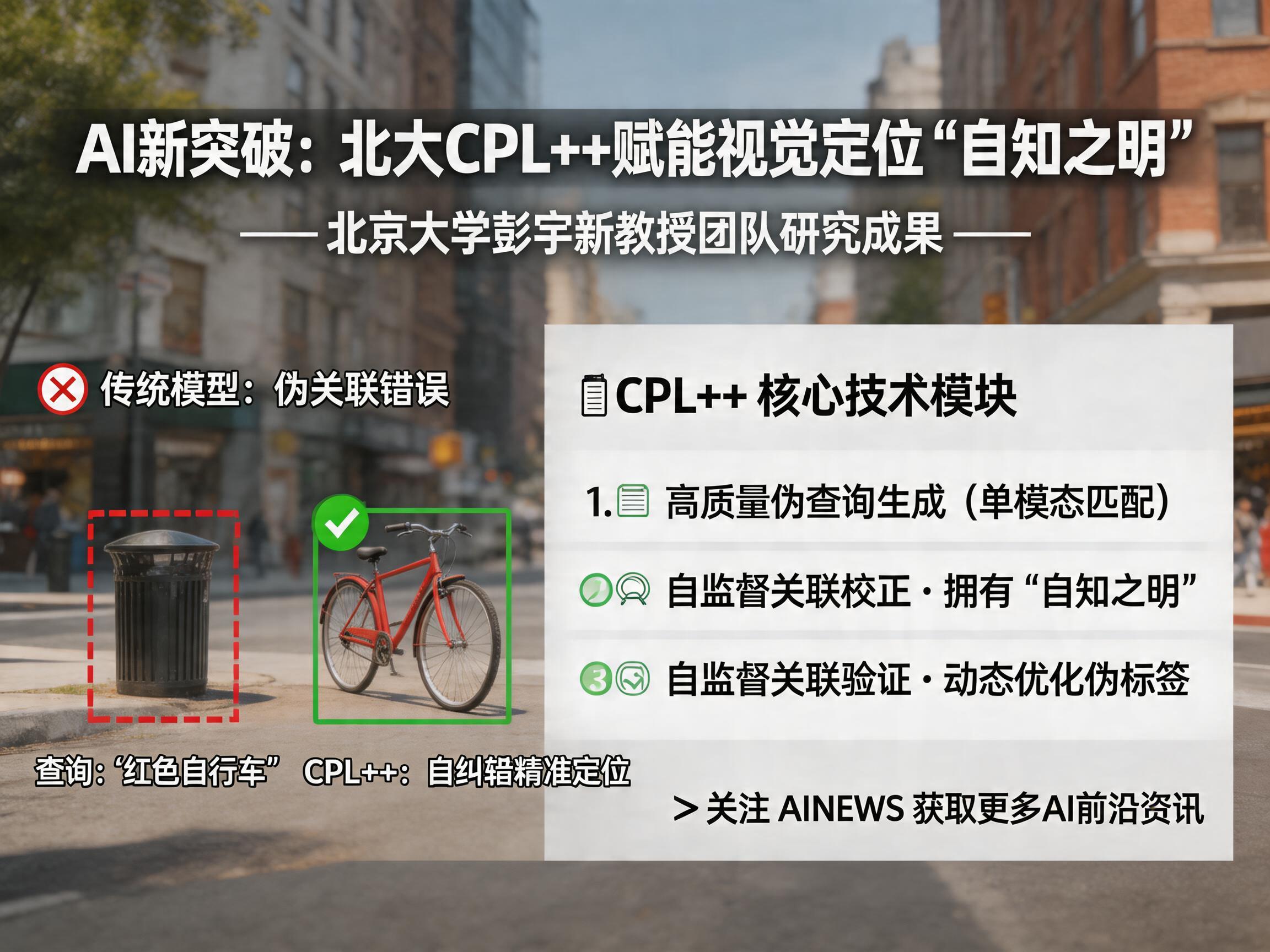

视觉定位新纪元:CPL++如何让AI模型拥有“自知之明”与“自我纠错”能力

在人工智能飞速发展的今天,AI技术正以前所未有的速度改变着我们的世界。特别是计算机视觉领域,各种创新层出不穷。今天,我们将深入探讨一项来自北京大学彭宇新教授团队的重磅研究成果——CPL++框架,这项研究为弱监督视觉定位模型带来了革命性的“自知之明”和“自我纠错”能力。这不仅是学术上的重大突破,更是推动人工智能技术走向更智能、更自主未来的关键一步。想要了解更多前沿AI资讯和AI新闻,请访问AINEWS。

弱监督视觉定位的挑战与AI的痛点

视觉定位(Visual Grounding)任务旨在根据自然语言描述,在图像中精准识别并定位目标区域。这项技术在智能安防、自动驾驶、人机交互等多个领域具有广阔的应用前景。然而,传统的全监督方法需要耗费巨大的人力物力去标注海量的“图像-文本-物体框”细粒度数据,这在处理大规模复杂场景时显得捉襟见肘。

为此,仅依赖“图像-文本”对进行训练的弱监督视觉定位应运而生,并受到广泛关注。但这种方法并非没有挑战。语言描述的高度抽象性与图像像素的具象性之间存在巨大的“异构鸿沟”,导致模型在训练过程中容易产生错误的跨模态关联,即“伪关联”。一旦模型学会了这些错误信息,便会陷入错误传播和累积的恶性循环,严重影响定位精度。这正是当前AI大模型在处理特定任务时面临的共同痛点之一。

CPL++:从“伪关联”到“真智能”的核心技术

为了解决这一难题,北京大学彭宇新教授团队提出了置信度感知的伪标签学习框架(CPL),并在此基础上进一步升级为CPL++。该框架的核心思想是让模型在训练过程中学会动态地发现、衰减并纠正自身的错误,从而实现弱监督视觉定位性能的显著提升。

CPL++的成功,离不开其精巧设计的几个关键技术模块:

1. 高质量伪查询生成与单模态匹配

面对跨模态匹配的固有困难,CPL++创新性地采用了单模态匹配策略来构造伪标签。它通过三条互补的生成管线——启发式增强(Heuristic+)、以对象为中心描述(Object-Centric)和以关系为中心描述(Relation-Aware),为图像中的每个候选区域生成丰富、真实且多样化的伪查询文本。随后,模型在文本特征空间内计算真实查询与这些伪查询之间的相似度,挑选出最匹配的区域作为初始伪标签,巧妙地避开了跨模态对齐的挑战。

2. 自监督关联校正与动态伪标签优化

CPL++框架最引人注目的革新在于其引入的自监督关联校正模块。这一模块赋予了模型“自知之明”的能力。它不再仅仅依赖于检测器的置信度,而是结合了查询文本中的类别、属性和空间关系等语义信息,构建了一个高质量的语义感知候选池。通过一个综合性的评估函数,CPL++能够全面、可靠地评估“区域-查询”伪标签的匹配程度,从而动态地发现并过滤掉可能错误的伪关联。更重要的是,它能在训练过程中不断“纠正”这些错误标签,实现伪标签的持续优化,使得模型能够从错误中学习,不断进步。

3. 自监督关联验证

CPL++的自监督验证机制巧妙地融合了强大的静态预训练模型所蕴含的先验知识,与定位模型在训练过程中不断动态进化的能力。这种结合有效地降低了误差传播的风险,确保了模型在自我学习和自我纠错过程中的稳定性与可靠性。

实验成果与AI前沿展望

彭宇新教授团队在RefCOCO、RefCOCO+、RefCOCOg、ReferItGame、Flickr30K Entities等五个主流弱监督视觉定位数据集上对CPL和CPL++进行了全面评估。实验结果令人振奋:CPL基础框架已超越现有弱监督与无监督方法,而具备自纠错能力的CPL++框架在此基础上进一步实现了显著的性能提升,最高绝对性能提升达5.81%。

这些突破性的成果不仅显著缩小了弱监督方法与全监督方法之间的性能差距,更彰显了伪标签自校正机制在突破弱监督视觉定位瓶颈方面的巨大潜力。可视化结果也清晰地展示了CPL++如何从最初的错误关联,通过单模态匹配和自监督校正,最终精准定位到正确目标的全过程,完美诠释了其“自我纠错”的强大能力。

结语

CPL++框架的提出,无疑为弱监督视觉定位乃至整个AI领域带来了新的思考。它证明了为AI模型赋予“自知之明”和“自我纠错”能力,是构建更智能、更鲁棒系统的重要途径。未来,我们期待这种自监督学习范式能在更多AI任务中发挥作用,推动人工智能技术迈向更高的台阶。关注AINEWS,获取更多AI、大模型、LLM、AGI等前沿科技资讯,共同见证人工智能的无限可能!

Loading...

.png?table=collection&id=cbe6506e-1263-8358-a4d7-07ce62fcbb3f&t=cbe6506e-1263-8358-a4d7-07ce62fcbb3f)