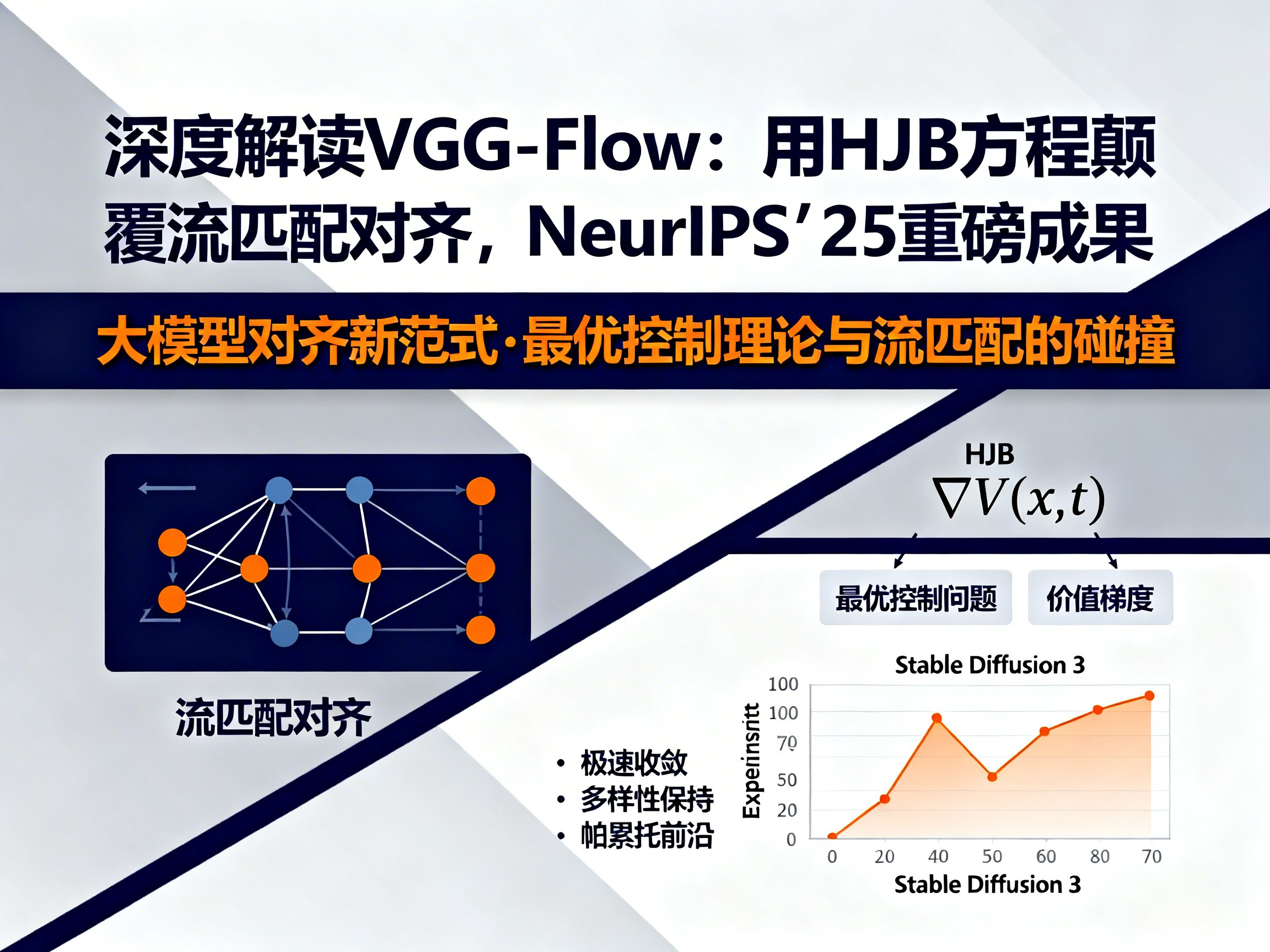

深度解读VGG-Flow:用HJB方程颠覆流匹配对齐,NeurIPS'25重磅成果

type

status

date

slug

summary

tags

category

icon

password

网址

引言:大模型对齐的新范式

在当今人工智能(AI)领域,如何让生成式模型(如扩散模型和流匹配模型)生成的输出符合人类偏好,一直是研究的热点。传统的对齐方法往往依赖于强化学习(RL),例如PPO或GRPO。然而,这些方法通常将模型视为黑盒,通过采样和策略梯度进行优化,过程复杂且方差极大。

随着NeurIPS 2025接收结果的公布,来自港中深、微软研究院等机构的VGG-Flow团队提出了一种颠覆性的思路:既然奖励函数(Reward Function)本身是可微的神经网络,为什么不直接利用其导数信息?通过引入连续时间最优控制理论中的HJB方程(Hamilton–Jacobi–Bellman Equation),VGG-Flow为流匹配模型的微调开辟了一条高效、稳定且具备严谨理论支撑的新路径。更多前沿AI资讯,欢迎访问 https://aigc.bar。

传统对齐路径的困境与局限

在VGG-Flow出现之前,流匹配模型的对齐主要面临两难境地:

- 黑盒强化学习路径:如Flow-GRPO。这类方法需要将确定性的ODE采样过程强行转换为随机的SDE,以便适配传统的RL框架。这不仅增加了计算开销,还引入了高方差的策略梯度,导致训练不稳定。

- 启发式直接优化路径:如ReFL。这类方法虽然尝试利用奖励梯度,但往往只针对采样路径中的某些特定步进行近似优化。这种做法缺乏严格的数学证明,容易导致模型出现“模式坍塌”(Mode Collapse)或过度拟合奖励函数而丧失生成多样性。

针对这些痛点,VGG-Flow团队回归第一性原理,将微调任务重新定义为一个最优控制问题。

HJB方程:将奖励转化为价值梯度

VGG-Flow的核心思想是将微调目标设定为:在最大化终态奖励的同时,最小化微调模型相对于预训练模型的轨迹偏离代价。

在最优控制理论中,价值函数 V(x,t) 描述了从某一状态出发所能获得的预期收益。根据HJB方程(这是贝尔曼方程在连续时间下的形式),最优的微调方向可以直接解析为价值函数的梯度:最优修正项 = ∇V(x,t)。

这意味着,我们不再需要复杂的采样优势函数或计算对数概率比,只需要准确估计这个“价值梯度”,就能以可微的方式直接更新流匹配模型的速度场。这种方法将原本复杂的强化学习问题简化为了一个梯度匹配问题,极大地提升了训练的鲁棒性。

VGG-Flow的核心创新:Forward-looking参数化

为了让价值梯度在训练初期就能提供有效的引导,VGG-Flow引入了Forward-looking参数化方法。其逻辑非常巧妙:

- 预估终点:在当前时间步,利用欧拉法(Euler method)快速预测一个可能的终点样本。

- 引导参数化:利用预估终点的奖励梯度来初始化当前的价值梯度。

通过这种设计,模型只需要学习如何修正这个“预估梯度”的残差。实验证明,即便不进行复杂的残差学习,仅仅依靠这种参数化引导,模型也能展现出惊人的对齐效果。这一发现为低成本微调大模型提供了新的可能。

实验验证:Stable Diffusion 3的高效对齐

研究团队在Stable Diffusion 3(SD3)上进行了广泛测试。在Aesthetic Score(美学评分)和PickScore(偏好评分)等多项指标下,VGG-Flow表现优异:

- 极速收敛:仅需约400次迭代更新,模型即可实现显著的奖励提升,收敛速度远超传统方法。

- 多样性保持:相比于其他方法,VGG-Flow在提升生成质量的同时,能够更好地保留预训练模型的分布先验,生成的图像更加自然且多样。

- 帕累托前沿:在奖励值与FID(图像质量指标)的权衡中,VGG-Flow占据了更优的帕累托前沿,证明了其在质量与对齐之间的卓越平衡。

总结与展望

VGG-Flow的成功不仅是数学理论在深度学习中的一次华丽应用,更为LLM和生成式AI的对齐提供了新的视角。它告诉我们,利用好模型内部的可微性,往往比将其视为黑盒进行暴力搜索更加有效。

随着AGI进程的加速,类似VGG-Flow这样兼具理论深度与实践效率的算法将成为推动行业发展的关键。对于开发者而言,理解并掌握这种基于最优控制的微调思路,将在未来的模型优化工作中占据先机。

获取更多关于人工智能、AI新闻及Prompt技巧的深度内容,请持续关注 https://aigc.bar,开启您的AI探索之旅。

Loading...

.png?table=collection&id=1e16e373-c263-81c6-a9df-000bd9c77bef&t=1e16e373-c263-81c6-a9df-000bd9c77bef)