英伟达算力霸权大变局:引入Groq LPU架构,OpenAI抢先部署专用推理芯片

type

status

date

slug

summary

tags

category

icon

password

网址

引言:算力王座的防御战

在AI大模型狂飙突进的今天,英伟达(NVIDIA)一直被视为算力世界的“卖铲人”。然而,随着大模型应用从实验室走向千家万户,算力需求正在经历一场结构性的巨变。最新的行业动态显示,在即将举行的GTC大会上,黄仁勋将发布一套颠覆性的AI推理系统。

令人意外的是,这款新芯片的核心架构并非来自英伟达引以为傲的GPU,而是源自此前收购的Groq团队所研发的LPU(语言处理单元)架构。作为全球AI芯片的领军者,英伟达首次在核心产品线上大规模引入外部架构,这一举动不仅标志着英伟达战略的转型,更预示着AI推理市场正成为各大巨头争夺的新高地。想要了解更多前沿AI资讯和AI新闻,欢迎访问 AI门户。

为什么是LPU而非GPU?深度解析架构之争

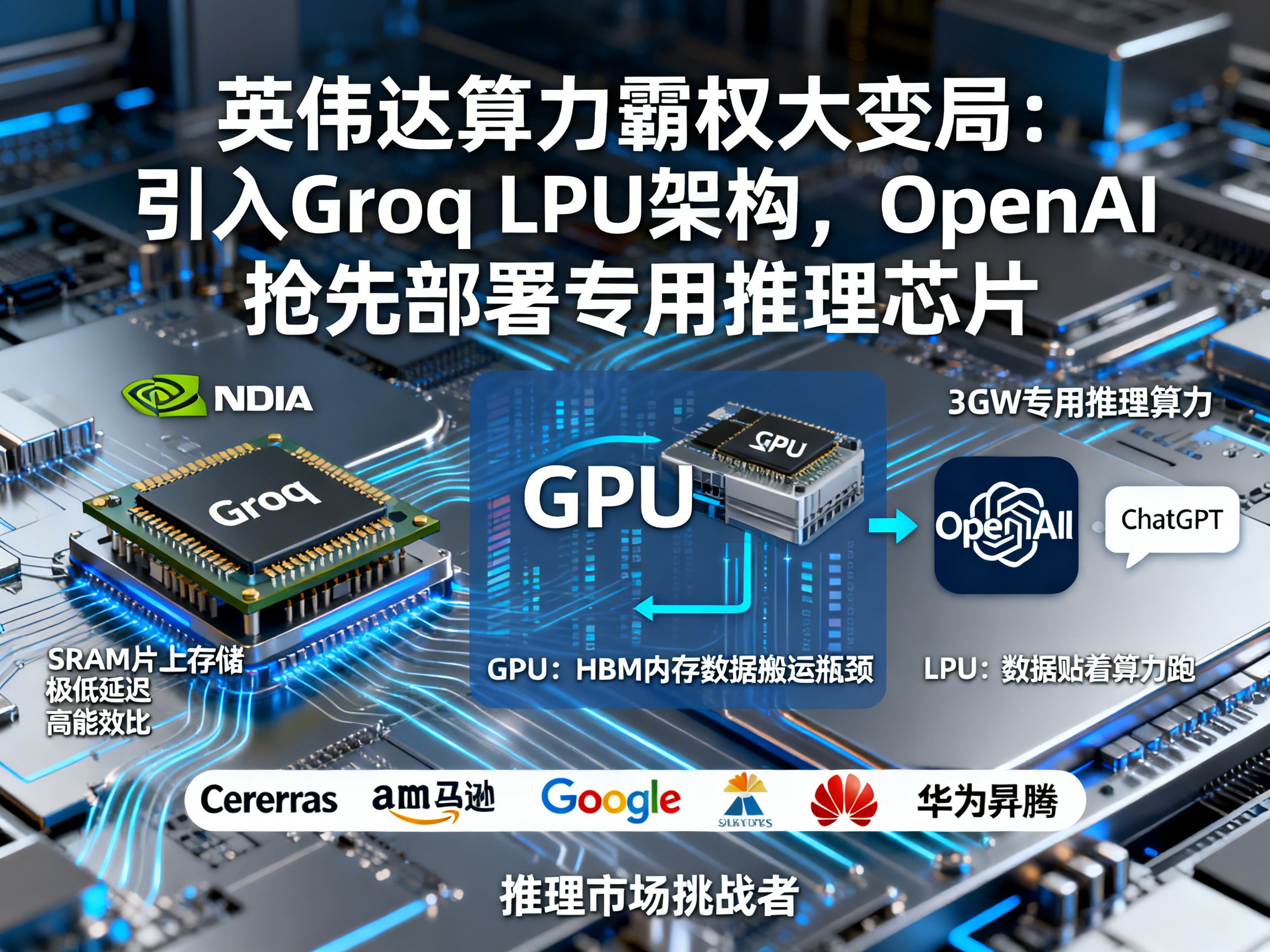

长期以来,GPU(图形处理器)凭借强大的大规模并行计算能力,成为了LLM(大语言模型)训练的不二之选。但在推理阶段,尤其是当AI应用需要实时响应用户指令时,GPU的局限性开始显现。

传统的GPU架构通常将模型参数存储在外部的HBM(高带宽内存)中,计算核心与内存之间的数据搬运频繁,这在低延迟要求的推理场景下形成了巨大的瓶颈。而Groq团队研发的LPU架构则另辟蹊径:

- SRAM片上存储:LPU采用高密度片上SRAM,让数据“贴着算力跑”,极大地缩短了数据传输路径。

- 极低延迟:在处理Token生成(decode阶段)时,LPU的效率理论上比传统GPU快出百倍,能完美适配Prompt实时反馈的需求。

- 高能效比:去除了不必要的并行开销,使得推理成本大幅降低。

英伟达果断引入这一架构,正是为了在推理市场快速补齐短板,确立绝对的竞争优势。

OpenAI第一个吃螃蟹:巨头的强强联手

这款基于LPU架构的新推理芯片,其首位“重量级”客户已经揭晓——正是刚刚完成巨额融资的OpenAI。

根据披露的合作细节,OpenAI将在其庞大的算力版图中,专门划拨出3GW的专用推理算力(dedicated inference capacity)给这套新系统。对于ChatGPT背后的运营者来说,推理成本的每一次优化,都意味着利润空间的提升和用户体验的飞跃。

这种合作模式也展示了黄仁勋极致的ROI(投资回报率)策略:不再执着于从零开始自研,而是通过“收购式招聘”(acqui-hire)快速整合成熟方案。200亿美元收购Groq核心团队的这笔投资,正在转化为英伟达在AGI时代最锋利的矛。

推理市场遭遇“围剿”:英伟达面临的多线挑战

尽管英伟达在训练市场拥有超过90%的份额,但在推理领域,挑战者们正从四面八方涌现。

- 垂直领域挑战者:Cerebras等初创公司宣称其芯片在特定场景下远超英伟达。

- 云巨头自研:亚马逊(Amazon)正大力推行其Trainium芯片,而谷歌则在TPU领域深耕多年。

- 国产算力的崛起:在国内市场,华为昇腾平台正加速模型迁移,DeepSeek等本土模型公司已开始绕过英伟达,直接在国产算力上完成部署。

- 竞争对手的合围:AMD与Meta联手优化推理架构,试图打破英伟达的垄断。

面对这些威胁,英伟达必须证明,它不仅能统治“训练”,也能主导“推理”。更多关于人工智能行业的深度分析,请关注 AI日报。

算力重心转移:Agent时代的必然选择

随着AI变现路径的日益清晰,AI应用正从简单的对话框转向复杂的Agent(智能体)。这意味着AI不再是偶尔被调用的工具,而是需要24小时不间断进行推理的后台负载。

当推理任务的频率和规模超越训练任务时,算力市场的逻辑就从“性能优先”转向了“成本与效率优先”。英伟达此次“架构换血”,本质上是对这一趋势的正面回应。它告诉市场,为了保持领先,英伟达不惜放弃对单一架构的坚持,转而拥抱更多元、更专业的计算单元。

结论:AI算力的新纪元

英伟达放弃在推理芯片上死守GPU架构,转而引入Groq的LPU,是AI硬件史上一个里程碑式的事件。这标志着AI芯片正式进入了“术业有专攻”的精细化竞争阶段。

对于开发者和企业而言,这意味着未来将有更低成本、更高性能的推理资源可用,从而加速大模型应用的规模化落地。无论你是寻找最新的提示词技巧,还是想了解AI变现的最新案例,持续关注 AI门户 将为你提供最及时的决策参考。

在即将到来的GTC大会上,除了LPU芯片,预计还会有Rubin系列GPU等更多“前所未见”的产品发布。这场算力竞赛,才刚刚进入下半场。

Loading...

.png?table=collection&id=1e16e373-c263-81c6-a9df-000bd9c77bef&t=1e16e373-c263-81c6-a9df-000bd9c77bef)