清华FaithLens:以解释为信号,8B模型幻觉检测反超GPT-4

type

status

date

slug

summary

tags

category

icon

password

网址

随着大语言模型(LLM)能力的飞速增长,AI生成内容的“幻觉”问题(Hallucination)依然是阻碍其在金融、法律、医疗等高风险领域落地的核心痛点。即便在大模型检索增强生成(RAG)的加持下,模型仍可能一本正经地胡说八道,生成流畅但与事实相悖的内容。

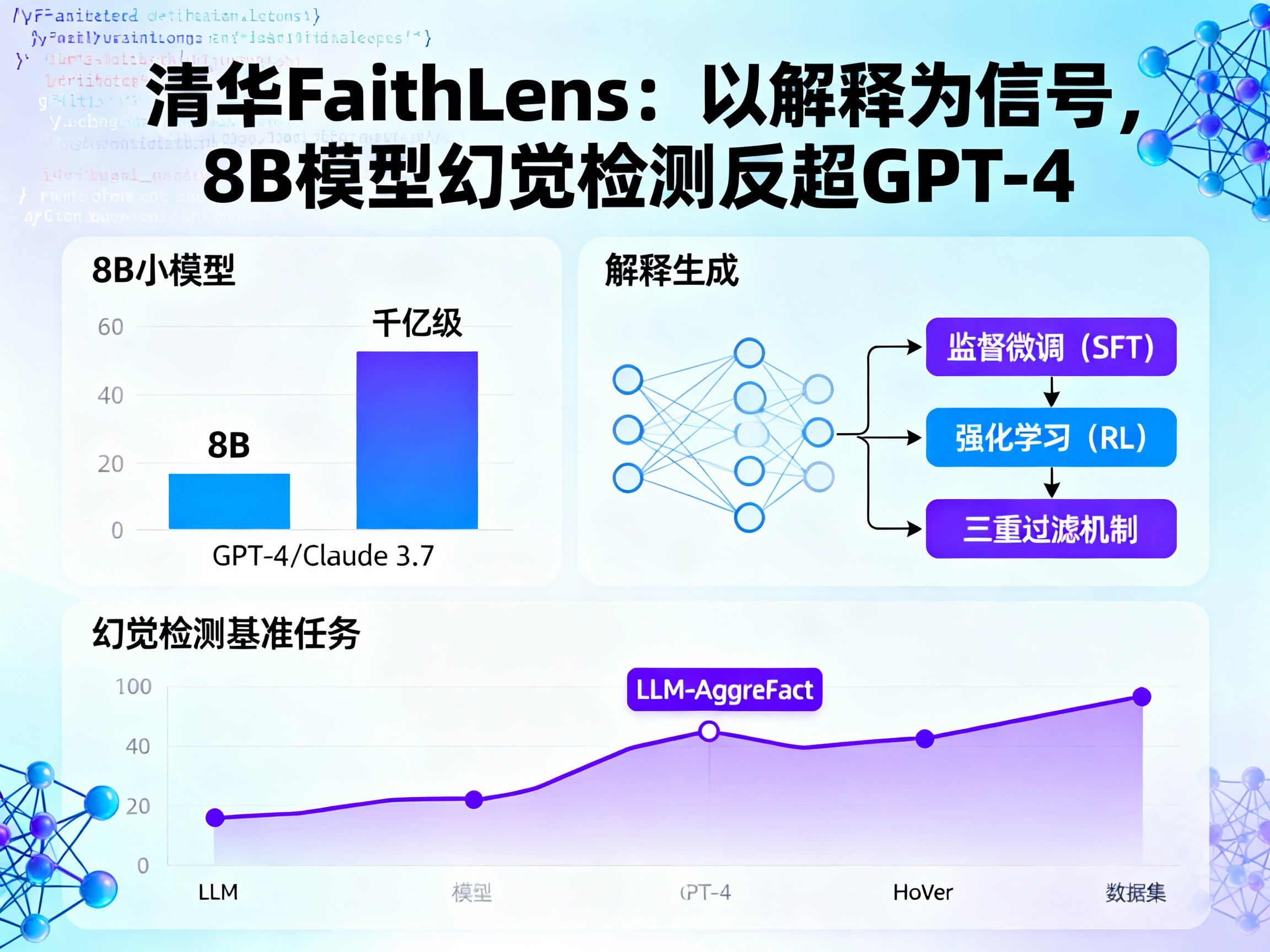

近期,清华大学孙茂松团队联合深言科技发布了一项重磅研究成果——FaithLens。这项研究提出了一种全新的训练范式:不再仅仅让模型判断“对错”,而是通过训练模型生成高质量的“解释”,并将“解释是否有用”作为核心信号。令人震惊的是,基于这一范式训练出的仅 8B 参数规模的模型,在多个幻觉检测基准上竟然反超了包括 GPT-4、Claude 3.7 Sonnet 在内的顶尖闭源大模型。本文将深入解读这一突破性进展。

8B小模型如何逆袭闭源巨头

在传统的AI开发逻辑中,通常认为“大力出奇迹”,更大的参数量意味着更强的推理和判别能力。然而,FaithLens 打破了这一刻板印象。

根据实验数据显示,FaithLens 在涵盖新闻摘要、RAG问答、事实核查等 12 个跨领域任务(基于 LLM-AggreFact 和 HoVer 基准)中,取得了当前最优的忠实性幻觉检测效果。值得注意的是,FaithLens 的参数规模仅为 8B,而其对比的对手包括 GPT-4o、o3、Llama-3.1-405B 等千亿级甚至万亿级参数的巨兽。

特别是在需要多跳推理的 HoVer 任务中,FaithLens 展现了惊人的优势。这说明它并非简单地进行模式匹配,而是真正具备了结构化的推理能力,能够像人类专家一样,综合多个证据片段来判断断言的真伪。对于关注 AI资讯 和 大模型 落地应用的企业而言,这意味着可以用极低的算力成本(相比 API 级闭源模型),获得最顶级的安全检测能力。

核心创新:以“解释”驱动训练

FaithLens 能够实现逆袭的核心,在于其重新定义了幻觉检测的任务目标。传统方法往往将幻觉检测视为一个二分类问题(有幻觉/无幻觉),是一个黑箱过程。而 FaithLens 的核心思路是:模型不仅要判断对错,还要生成清晰、具体且能帮助他人做出判断的解释。

研究团队认为,一个高质量的解释,应该能够让一个能力较弱的“新手模型”也能据此做出正确的判断。基于这一理念,FaithLens 引入了一套结合监督微调(SFT)和强化学习(RL)的创新训练框架。

在这一框架下,“解释”不再是附属品,而是训练的“燃料”。系统会评估模型生成的解释是否具备信息量、是否逻辑自洽,并将其直接转化为优化模型的奖励信号。这种机制迫使模型在给出结论前,必须先理清逻辑链条,从而显著降低了误判率。

三重过滤与强化学习的精妙结合

为了训练出既能判别又能解释的模型,研究团队设计了精密的“冷启动”与“强化”流程。

在监督微调(SFT)阶段,团队利用强大的推理模型生成合成数据,并实施了严苛的“三重过滤机制”:

1. 标签一致性过滤:确保强模型给出的标签与原始标注一致,防止学习错误知识。

2. 解释效用过滤:这是一个创新指标。系统会计算加入解释后,模型预测正确标签的困惑度是否下降。如果解释不能降低困惑度(即没有提供有效信息),该样本就会被剔除。

3. 多样性过滤:通过聚类算法控制样本分布,避免模型只学会处理简单样本,确保其能应对各种复杂的幻觉类型。

在随后的强化学习(RL)阶段,团队采用了 GRPO 算法,并设计了独特的奖励函数。其中最关键的是“解释质量奖励”:系统引入一个较弱的模型作为评价器,如果 FaithLens 生成的解释能帮助这个弱模型做对题,FaithLens 就会获得高分奖励。这种“以教促学”的方式,极大地提升了模型的解释生成质量。

从黑箱到透明:AI可信性的新标准

FaithLens 的成功不仅仅是刷榜那么简单,它对 AI新闻 和 AGI 领域具有深远的方法论意义。

首先,它解决了“黑箱判别”的问题。以往的检测工具只告诉用户“这里错了”,却不告诉“为什么”。FaithLens 能够指出具体是“数字被曲解”还是“因果关系倒置”,让幻觉检测变得透明、可审查。这对于金融审计、法律合规等领域至关重要。

其次,它证明了中等规模模型在特定高阶任务上的潜力。通过精心设计的数据策略和训练目标,8B 模型完全可以胜任以往认为只有超大模型才能做好的工作。这为企业降低 AI变现 成本、实现私有化部署提供了强有力的技术支撑。

结语

清华孙茂松团队与深言科技的这项合作,不仅为解决大模型幻觉问题提供了一把“手术刀”,更展示了中国科研团队在 NLP 基础理论与训练范式上的创新实力。随着 FaithLens 技术的开源与普及,我们有理由相信,未来的 人工智能 系统将变得更加诚实、透明且可信。

如果您想了解更多关于 AI、大模型 以及 Prompt 工程的最新动态,欢迎访问 AIGC.BAR,获取最前沿的 AI资讯 和 AI日报。

Loading...

.png?table=collection&id=1e16e373-c263-81c6-a9df-000bd9c77bef&t=1e16e373-c263-81c6-a9df-000bd9c77bef)